- HOME

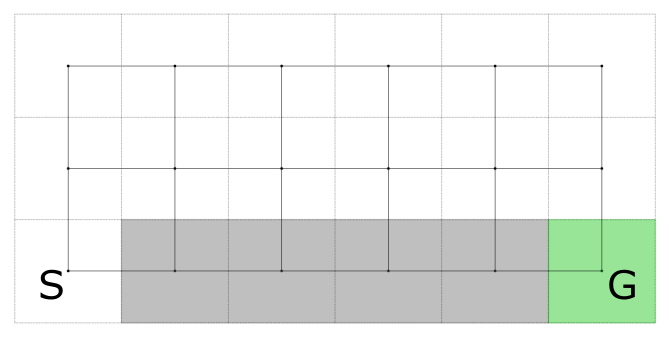

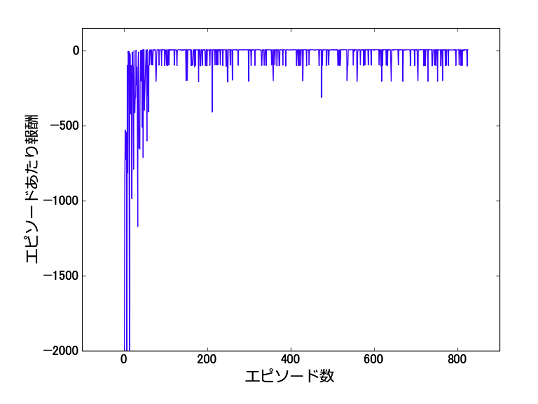

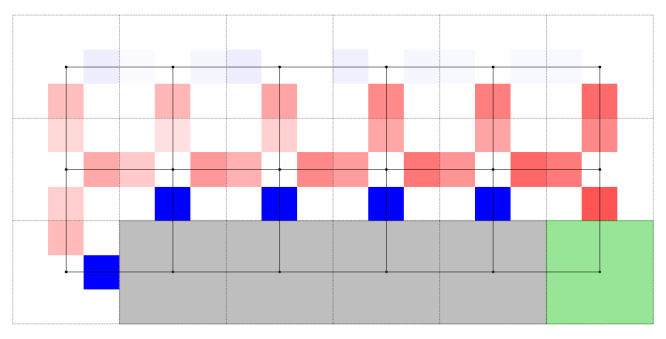

- S4 で始める強化学習(第4回)エージェントシミュレーションで使ってみる

更新日:2025年2月12日 17:36

公開日:2023年1月16日 19:01

記事一覧

- S4 で始める強化学習(第1回)離散イベントシミュレーションで使ってみる

- S4 で始める強化学習(第2回)離散イベントシミュレーションで作ってみる

- S4 で始める強化学習(第3回)離散イベントシミュレーションで理解を深める

- S4 で始める強化学習(第4回)エージェントシミュレーションで使ってみる

- S4 で始める強化学習(第5回)エージェントシミュレーションで作ってみる(1/2)

- S4 で始める強化学習(第6回)エージェントシミュレーションで作ってみる(2/2)

- S4 で始める強化学習(第7回)エージェントシミュレーションで理解を深める

- S4で始める強化学習(第8回)在庫管理問題で使ってみる

- S4で始める強化学習(第9回)在庫管理問題で作ってみる(1/3)

- S4で始める強化学習(第10回)在庫管理問題で作ってみる(2/3)

- S4で始める強化学習(第11回)在庫管理問題で作ってみる(3/3)

- S4で始める強化学習(第12回)在庫管理問題で理解を深める